AI 一站式短剧/漫剧生成平台Industrial AI Motion Comic & Video WorkbenchAI 漫剧工场 是一个面向短剧、漫剧、动态漫 2026-5-10 03:32:0 Author: blog.upx8.com(查看原文) 阅读量:5 收藏

AI 一站式短剧/漫剧生成平台

Industrial AI Motion Comic & Video Workbench

AI 漫剧工场 是一个面向短剧、漫剧、动态漫画与影视分镜创作者的 AI 生产工作台,目标是把故事创意快速转化为可预览、可导出、可继续剪辑的视觉资产与视频片段。

项目采用 Script-to-Asset-to-Keyframe 工作流:先完成剧情与分镜,再生成角色/场景资产,随后在 AI工作台中制作关键帧与视频,最后统一预览和导出。

普通电脑安装文件支持windows

Windows : 安装文件https://github.com/yuanzhongqiao/deep-printfilm/archive/refs/tags/PrintFilmPro-V-0.8.03.zip

传统 Text-to-Video 往往难以稳定控制角色、构图和镜头起止画面。AI 漫剧工场引入动画与影视制作中的关键帧思路:

- 先画后动:先生成镜头的起始帧与结束帧。

- 插值生成:通过视频模型在关键帧之间生成运动过渡。

- 资产约束:画面生成会参考角色定妆、服装变体和场景概念图,提升角色一致性与场景连续性。

- 流程化生产:每个阶段都围绕同一个项目状态推进,减少反复复制提示词和手工整理资产的成本。

剧情创作阶段用于把故事、小说片段或短剧创意整理为可生产的结构化内容。

- 智能剧本拆解:输入故事大纲或正文,AI 自动生成剧本结构、角色、场景和分镜。

- 分镜规划:按目标时长和节奏生成镜头列表,包含动作、台词、画面提示词等信息。

- 视觉化翻译:将文字描述转为更适合图像生成模型使用的画面提示词。

- 手动编辑:支持编辑角色描述、场景描述、镜头动作、台词和分镜画面提示词。

- 项目配置:支持目标时长、语言、模型和视觉风格等基础参数。

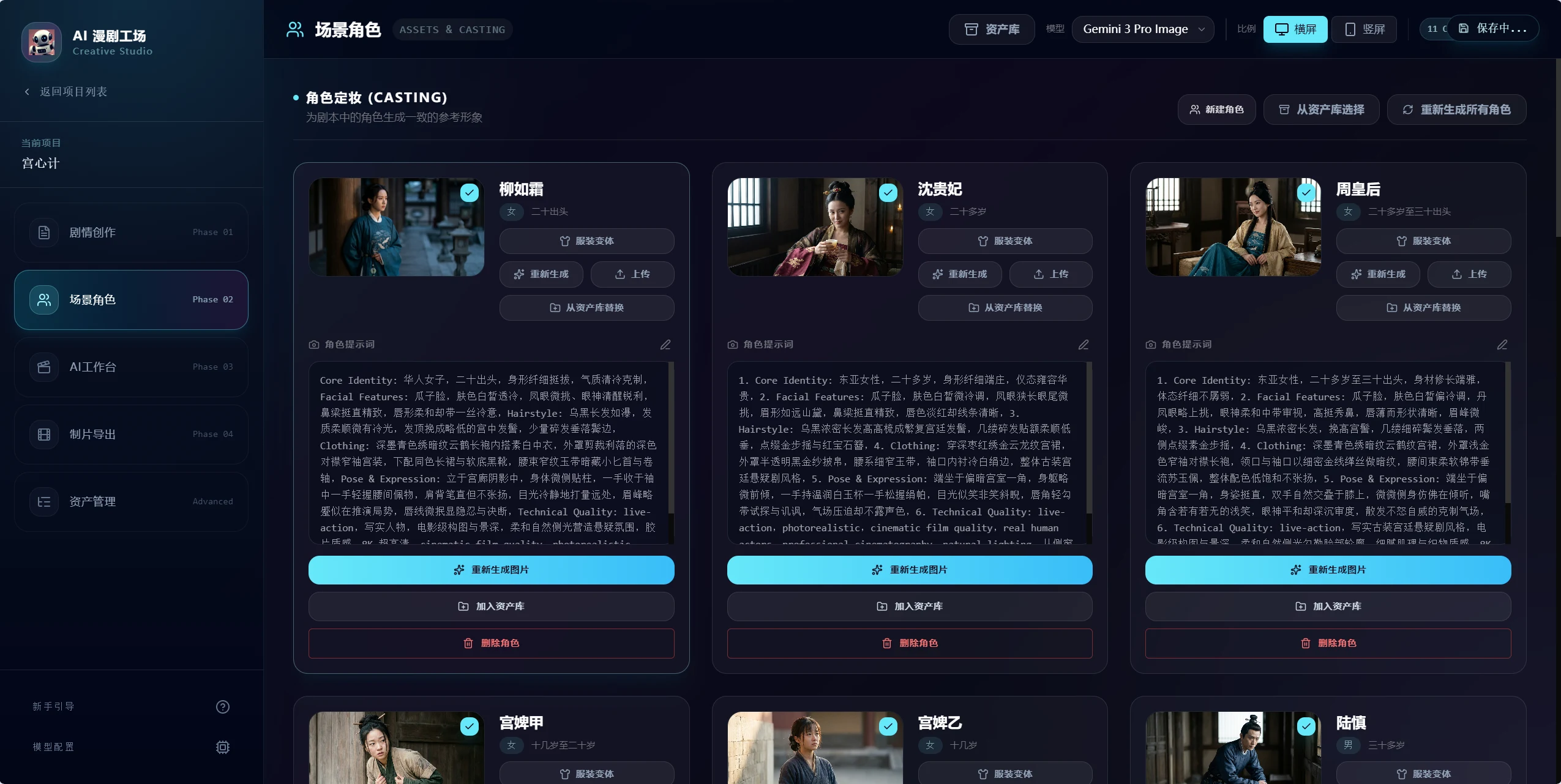

场景角色阶段用于沉淀后续画面生成需要使用的核心视觉资产。

- 角色定妆:为每个角色生成标准参考图。

- 服装变体:为角色维护多套造型,如日常、战斗、受伤、礼服等。

- 场景概念图:为故事中的关键场景生成环境参考图。

- 图片上传:支持手动上传角色、服装或场景图片作为参考资产。

- 批量生成:可以按角色或场景批量生成资产,减少重复操作。

AI工作台是关键帧与视频片段制作的核心区域。

- 镜头管理:以网格和工作台形式管理所有镜头。

- 关键帧生成:为镜头生成起始帧和结束帧,便于控制构图和动作变化。

- 上下文参考:生成时会结合当前场景、角色定妆和服装变体,提升连续性。

- 镜头拆分:支持将长镜头拆分为子镜头,细化动作节奏。

- 视频生成:支持基于关键帧的视频生成流程,并记录渲染日志与状态。

制片导出阶段用于集中预览、检查和下载项目成果。

- 时间轴预览:按镜头顺序查看已生成的视频片段。

- 视频播放:支持逐段预览镜头成片。

- 渲染日志:集中查看角色、场景、关键帧和视频生成记录。

- 资产下载:导出关键帧、视频片段和项目资产,便于进入后期剪辑流程。

资产管理用于集中查看和调整项目中的提示词资产。

- 角色提示词:查看与编辑角色、服装变体相关提示词。

- 场景提示词:查看与编辑场景描述和图像提示词。

- 关键帧提示词:查看与编辑镜头关键帧提示词。

- 视频提示词:查看和调整视频生成描述。

- 搜索与筛选:按角色、场景、镜头和状态快速定位资产。

- 前端框架:React 19 + TypeScript + Vite

- 界面样式:Tailwind CSS + 工业风深色界面

- 图标库:lucide-react

- 本地存储:IndexedDB,用于保存项目、角色、场景、镜头和生成记录

- AI 接口:GitCC API,兼容 OpenAI 风格接口

- 图片/视频资产:支持 Base64、远程 URL、关键帧图像与视频片段

- 桌面端:Electron + electron-builder

- 容器部署:Docker + Nginx

项目默认围绕 GitCC API 提供的文本、图像与视频模型组织工作流:

- 文本模型:用于剧本拆解、角色/场景分析、提示词改写和视频描述生成。

- 图像模型:用于角色定妆、服装变体、场景概念图和关键帧生成。

- 视频模型:用于根据提示词、起始帧或起止关键帧生成视频片段。

模型配置可以在应用内调整,适配不同上游模型名称、接口路径和参数。

- 项目数据主要保存在浏览器 IndexedDB 中。

- API Key 保存在本地配置中,用于调用 GitCC API。

- 应用不依赖自建业务后端,开发和桌面端会通过代理解决浏览器跨域问题。

- 若清理浏览器站点数据,项目内容也会被清除,请按需导出备份。

启动后访问终端输出的本地地址。Vite 开发环境会代理 /api-proxy 到 GitCC API,便于本地调试。

npm run build npm run preview

docker-compose up -d --build docker-compose logs -f docker-compose down

默认通过 3005 端口访问。Compose 会生成 ai-manga-studio:latest 镜像、ai-manga-studio-app 容器和 ai-manga-studio-network 网络。Nginx 会托管前端静态文件,并代理 /api-proxy 到 GitCC API。

docker build -t ai-manga-studio .

docker run -d -p 3005:80 --name ai-manga-studio-app ai-manga-studio

docker logs -f ai-manga-studio-app

docker stop ai-manga-studio-app

npm run electron:dev npm run electron:build npm run electron:build:win

electron:dev:先构建前端,再启动 Electron 窗口。electron:build:使用 electron-builder 生成桌面安装包。- Windows 安装包会以

AI 漫剧工场为产品名输出到release/目录。 - 桌面端内建本地 HTTP 服务,托管前端并代理

/api-proxy到 GitCC API。

- 启动应用后,在模型配置中填写 GitCC API Key。

- 进入 Phase 01「剧情创作」,输入故事创意并生成剧本和分镜。

- 进入 Phase 02「场景角色」,生成角色定妆、服装变体和场景图。

- 进入 Phase 03「AI工作台」,逐个生成关键帧和视频片段。

- 进入 Phase 04「制片导出」,预览并下载关键帧、视频和项目资产。

- 如需调整提示词,进入「资产管理」统一查看和编辑。

npm install npm run dev npm run build npm run preview npm run electron:dev npm run electron:build docker-compose up -d --build docker-compose down

.

├── App.tsx

├── components/

│ ├── Dashboard.tsx

│ ├── Sidebar.tsx

│ ├── ModelConfig/

│ ├── Onboarding/

│ ├── StageScript/

│ ├── StageAssets/

│ ├── StageDirector/

│ ├── StageExport/

│ └── StagePrompts/

├── electron/

├── public/

├── services/

├── types/

├── types.ts

├── vite.config.ts

├── Dockerfile

├── docker-compose.yaml

└── nginx.conf

- 短剧和漫剧前期开发

- 动态漫画和分镜预演

- 角色与场景视觉设定

- AI视频片段批量生成

- 创意原型验证和资产整理

AI 视频最麻烦的地方,往往不是生成,而是前后接不上

传统的散装操作中,提示词的连贯性和资产管理全靠脑子记。上一秒主角穿西装,下一秒就变夹克,为了修这些 Bug,创作者只能在各个工具之间来回复制粘贴。

deep-printfilm 采用的是 Script-to-Asset-to-Keyframe(剧本-资产-关键帧)逻辑。在这个后台里,你可以先输入故事大纲拆成分镜,然后生成角色的基础定妆照和各套服装变体。最后在生成视频片段时,让模型尽量参考这些已经定好的视觉资产。

它就像一个 AI 视频生产流水线的车间主任,不亲自干活,但负责把你乱七八糟的提示词和素材分门别类管好,让每次调用模型时都有统一的参考图,尽量不让前后剧情脱节。

deep-printfilm 如何把剧本、角色和关键帧串起来

这个工具并没有试图搞个“一键出片”的噱头,而是把工作流切分得很清晰实在:

第一步先搞定文本(剧本和分镜节奏);第二步确立视觉资产(角色、服装和环境概念图);第三步才是真正的生成工作台。在这个核心操作区,所有的镜头都以网格形式管理。你可以为每个镜头生成起始关键帧,再基于关键帧去跑视频。

这种做法最大的好处,是把原本散落在 txt 记事本、图片文件夹和生成记录里的素材,集中到同一个项目里管理。

本地部署不等于完全离线,API 和数据备份要提前想清楚

目前该项目在GitHub上已有接近千星关注,并发布了正式的 Release 版本,属于近期关注度上升较快的新工具。

对于小白用户,开发者提供了基于 Electron 打包的 Windows 桌面端直接安装。但如果你本身有 Docker 部署经验,也可以把它跑在服务器、NAS 或本地开发环境里,它也完全支持 Docker 服务端部署或本地开发环境运行。

不过在部署和使用之前,有几件事需要提前确认:

API 依赖与费用限制:很多人看到“本地部署”会误以为它是免费离线的。实际上,它的文本、图像和视频生成重度依赖第三方 API(默认兼容 GitCC 或 OpenAI 格式)。跑模型是要花钱的,接口的稳定性、计费方式需要你自己去评估。

小心你的项目数据被清空:这个工具把所有的剧情、分镜资产全部存在本地浏览器的 IndexedDB 里。这意味着项目状态主要保存在本地,响应更直接;但生成文本、图像和视频时,相关提示词、图片参考和请求内容仍可能发送到第三方 API,不能简单理解成“完全不上云”,但千万不要随便清理浏览器缓存或站点数据,否则辛辛苦苦建的项目可能瞬间蒸发。

商业化与许可边界:如果你打算用它生成的受版权保护的小说或影视 IP 视频去跑商业流量,务必自行核对模型服务商的使用条款,避免版权坑。

适合折腾 AI 短剧的人,不适合一键出片幻想

如果你已经跑通过一两次 AI 视频流程,受够了频繁切换窗口的折磨,deep-printfilm 是一个思路很对、能帮你省下大量项目管理精力的提效工具。

但如果你是完全没接触过 API 调用的纯新手,指望下载安装后点个按钮就能吐出一部能赚钱的短剧,那它不适合你。真正的门槛永远不在于工作台的安装,而在于你如何写出好的提示词,以及搞定稳定且高性价比的模型接口。

建议普通用户可以先做个小范围试用,跑通一个几十秒的短片看看效果,再决定要不要把它作为主力的生产工具。

deep-printfilm帮你管的是流程,不是替你拍片

deep-printfilm 真正有用的地方,不是让 AI 突然变得更会拍视频,而是把原本散落的剧本、角色设定、场景参考、关键帧和视频片段放进同一个项目里。对已经折腾过 AI 视频的人来说,这种“把东西管清楚”的能力,反而比多一个生成按钮更实际。

如果你期待的是下载安装后自动生成一部完整短剧,它大概率会让你失望。但如果你已经有自己的剧本、角色设定和生成流程,只是受够了文件夹混乱、提示词散落和镜头前后接不上的问题,那它确实值得试一试。

项目主页与源码入口

如有侵权请联系:admin#unsafe.sh