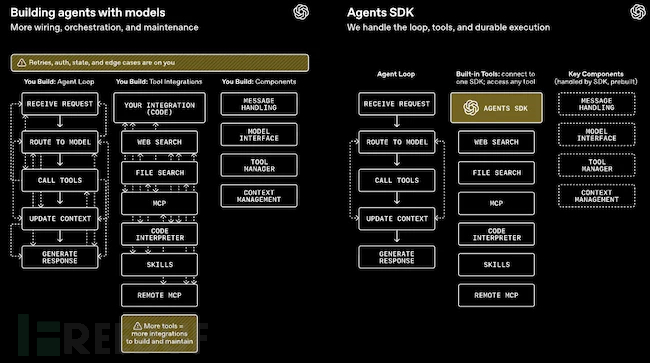

OpenAI 最新升级的 Agents SDK 可帮助开发者在受控沙箱环境中构建具备文件检查、命令执行、代码编辑及任务处理能力的 Agent。本次更新为 OpenAI 模型提供了标准化基础设施,包含让 Agent 能操作计算机文件与工具的模型原生框架,以及保障任务安全执行的原生沙箱环境。

框架架构创新

当团队从原型开发转向生产环境时,现有系统往往存在局限性。模型无关框架虽提供灵活性,却常导致前沿模型能力利用不足;模型供应商 SDK 虽贴近模型特性,但会限制框架可见度;托管 Agent API 简化了部署流程,却对 Agent 运行位置和敏感数据访问方式施加限制。

律商联讯首席 AI 官 Min Chen 表示:"OpenAI Agents SDK 通过内置安全措施的统⼀框架,以及安全隔离的数据处理和代码执行环境,实现了复杂法律文件起草与工作流构建。这让团队能专注于开发高价值、长期运行的法律 Agent,而非从零搭建基础设施。"

升级后的框架扩展了 Agent 处理文档、文件和系统的能力,包含可配置内存、沙箱感知编排、类似 Codex 的文件系统工具,以及与常见 Agent 系统原语的标准化集成。公司说明称:"这些原语包括通过 MCP 使用工具、借助 skills 实现渐进式披露、通过 AGENTS.md 定制指令、使用 shell 工具执行代码、运用 apply_patch 工具编辑文件等功能。"

该框架大幅减少基础设施搭建时间,使开发者能聚焦领域逻辑开发,未来还将持续扩展更多 Agent 模式与原语。其设计使模型执行与性能特征相匹配,保持 Agent 贴近模型运行模式,显著提升跨工具系统长期运行或协同任务的可靠性。

沙箱执行环境

新版 Agents SDK 内置沙箱执行功能,Agent 可在具备文件访问、工具调用及依赖项支持的受控环境中运行。该执行层免除了开发者自建环境的需求,支持使用自有沙箱或选择 Blaxel、Cloudflare、Daytona 等七家厂商的预置方案。

公司技术说明指出:"为实现跨供应商环境可移植性,SDK 引入了用于描述 Agent 工作空间的 Manifest 抽象层。开发者可挂载本地文件、定义输出目录,并连接 AWS S3、谷歌云存储等主流存储服务。"该 SDK 提供统一的环境定义方式,为模型构建包含明确输入输出及组织结构的可预测工作空间。

安全可靠与扩展能力

Agent 系统在设计阶段即考虑提示注入和数据渗出风险,通过框架与计算层分离确保凭证不会进入模型生成的执行环境。外部化 Agent 状态保障了沙箱容器崩溃后任务持续运行——SDK 会通过内置快照与状态恢复机制,在新容器中从最后检查点继续执行。

Agent 运行支持单沙箱或多沙箱模式,可按需调用沙箱实例,将子 Agent 路由至隔离环境,还能跨容器并行执行任务以加速处理。

参考来源:

OpenAI updates Agents SDK, adds sandbox for safer code execution

本文为 独立观点,未经授权禁止转载。

如需授权、对文章有疑问或需删除稿件,请联系 FreeBuf

客服小蜜蜂(微信:freebee1024)