CanIRun.AI – 你的电脑能跑哪些本地 AI 大模型?这个网站打开就能看到

嗯,用户让我帮忙总结一下这篇文章的内容,控制在一百个字以内,而且不需要用“文章内容总结”或者“这篇文章”这样的开头。直接写文章描述就行。

首先,我得仔细阅读一下原文。文章主要讲的是AI Token费用高,导致用户转向本地大模型。然后介绍了两款工具:llmfit和CanIRun.AI。llmfit需要下载软件,而CanIRun.AI是一个网站,可以自动检测硬件信息,并推荐适合的大模型。

接下来,我需要提炼出关键点:AI Token昂贵,本地模型的好处,两款工具的介绍及其优缺点。然后把这些信息浓缩到100字以内。

可能的结构是:先说问题(Token贵),然后解决方案(本地模型),接着介绍工具(llmfit和CanIRun.AI),最后说明它们的作用。

要注意用词简洁,避免重复。比如,“硬件识别准确”可以简化为“硬件识别准确”。

最后检查一下字数是否在限制内,并确保内容完整。

</think>

文章介绍了如何通过工具检测电脑硬件配置以选择适合运行的AI大模型,推荐了llmfit和CanIRun.AI两款工具,并详细说明了它们的功能和优缺点。

2026-3-17 02:21:11

Author: www.appinn.com(查看原文)

阅读量:30

收藏

AI Token 很贵,而且没完没了,这是所有 AI 重度用户迟早会面对的问题。

于是越来越多人开始尝试本地大模型——只要电脑能跑,就相当于拥有“无限 Token”。

但关键问题是:你的电脑到底能跑哪些 AI 模型?

前几天分享了一款软件:llmfit – 1秒测出:你的电脑能跑哪些 AI 大模型,它可以测出你的电脑硬件配置,再显示出当前配置下,能跑哪些大模型。

- 优点:硬件识别准确、可选模型多。

- 缺点:就是需要下载一个软件

那么,有没有不需要下载软件也能识别的呢?

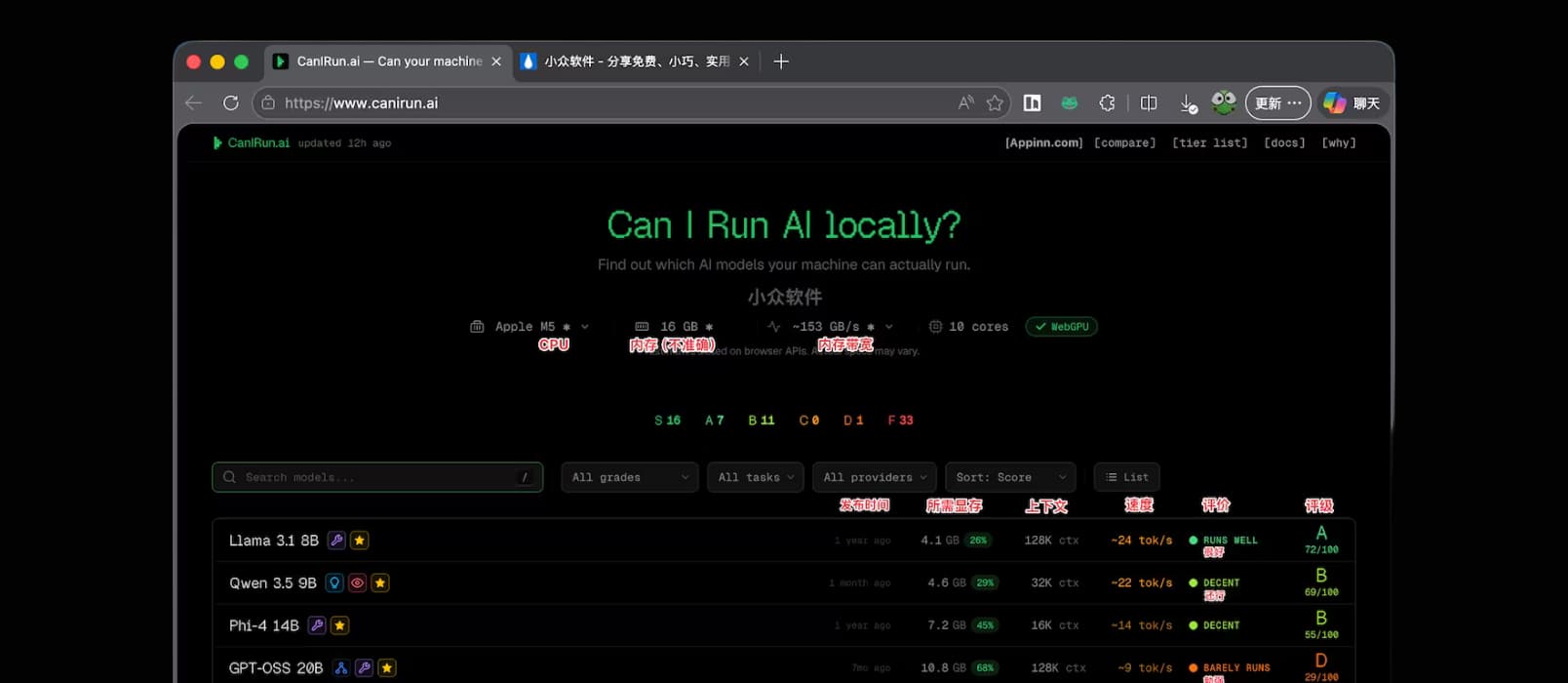

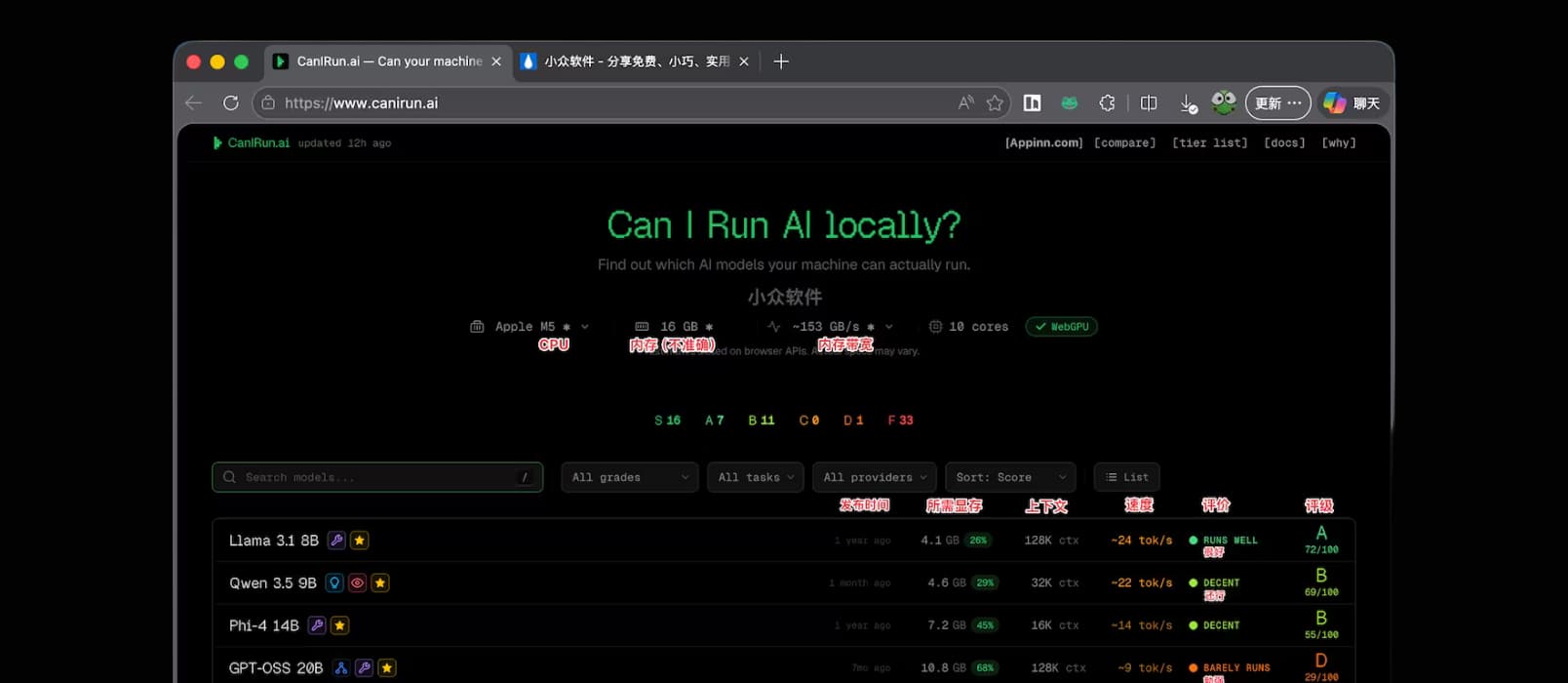

CanIRun.AI 就是为了解决这个问题而诞生的。

这是一个可以自动获取你的电脑硬件信息,主要包括 CPU、显卡、内存(大概)信息,然后给你可用的大模型列表的网站。

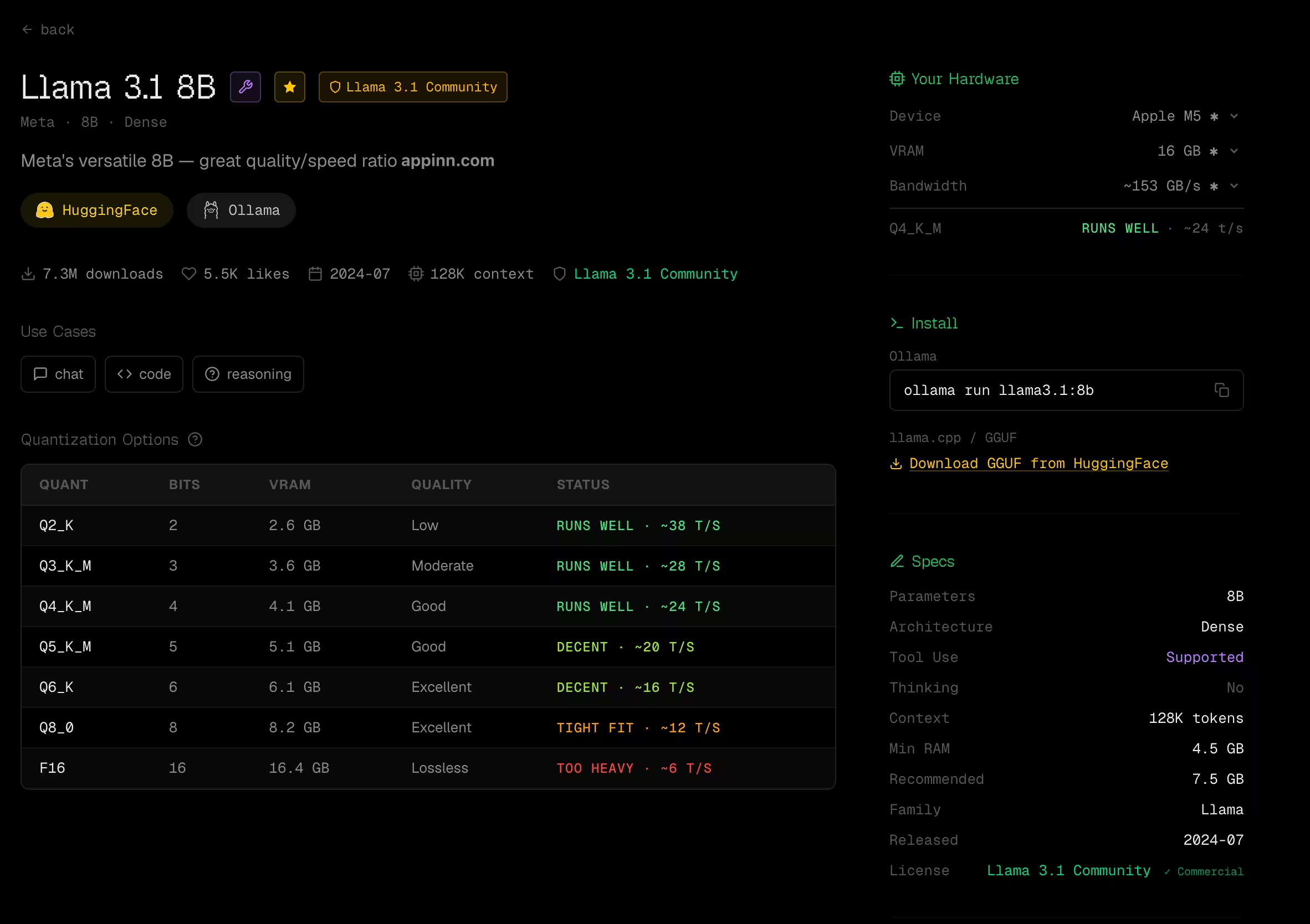

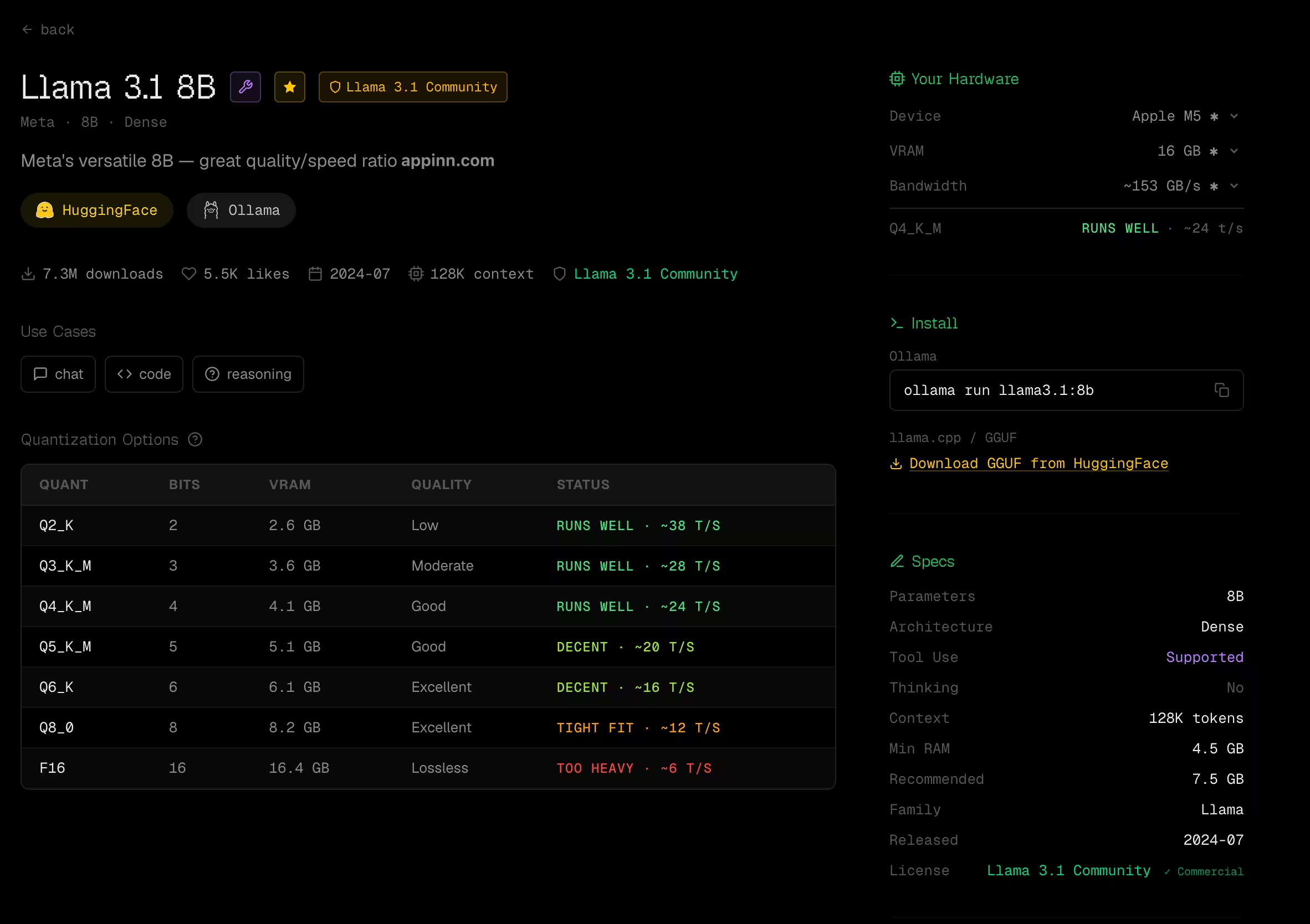

进入详细大模型页面后,还有更详细的内容,包括:

- ollama 安装命令

- HuggingFace 下载链接

- 下载次数/爱心统计

- 量化选项

- 详细参数等

为什么它能知道你的硬件信息?

关于这个问题,青小蛙也去研究了一下,于是有了这个网站:

这是青小蛙让 AI 写的一个用浏览器检测用户硬件信息的页面,包括 CPU、内存、显示器信息、显卡信息、存储、预估带宽等信息,简单易用。

原文:https://www.appinn.com/canirun-ai/

Enable Notifications

OK

No thanks

文章来源: https://www.appinn.com/canirun-ai/

如有侵权请联系:admin#unsafe.sh