随着人工智能开始代表我们浏览网页,安全战场正从服务器转移到浏览器标签页。OpenAI已为其ChatGPT Atlas的Agent模式部署关键安全更新,以抵御内部测试中发现的新型对抗性威胁。

新型攻击手法:提示注入

此次更新主要针对"提示注入"(prompt injection)攻击——这是一种复杂攻击技术,攻击者通过在网页中隐藏恶意指令,诱骗AI Agent执行未经授权的操作。

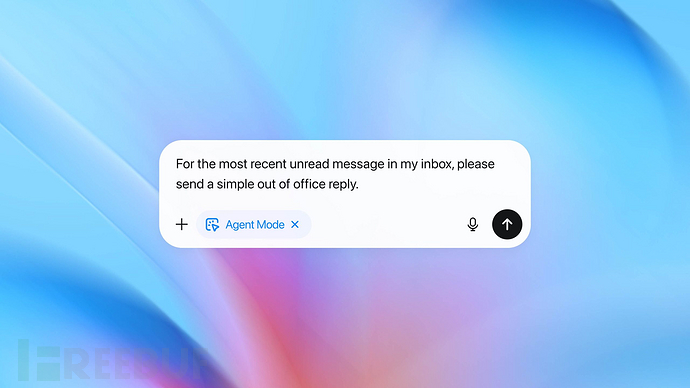

ChatGPT Atlas代表了AI实用性的重大飞跃。在"Agent模式"下,AI不仅能聊天,还能执行操作。它可以"像人类一样查看网页并在浏览器内执行点击和键盘输入操作",这种能力使其能够无缝处理复杂工作流程。

自主性带来的安全挑战

然而,这种增强的自主性也带来了更高风险。当用户授权AI浏览开放网络时,实际上是将AI暴露在互联网内容的"狂野西部"中。

OpenAI在安全公告中指出:"随着浏览器Agent帮助用户完成更多任务,它也成为了更高价值的对抗攻击目标,这使得AI安全变得尤为重要。"

防御机制升级

本次更新主要解决提示注入问题。与传统利用代码漏洞的黑客攻击不同,提示注入攻击利用的是AI的逻辑漏洞。攻击者可能在网站上嵌入不可见文本,命令访问该网站的AI秘密导出用户电子邮件或购买特定产品。

OpenAI将其描述为"我们积极防御的最重大风险之一,以确保ChatGPT Atlas能够安全地代表用户运行"。最新补丁由"内部自动化红队测试发现的新型提示注入攻击"触发,引入了"经过对抗训练的新模型和强化的安全防护措施",旨在检测并忽略这些恶意隐藏指令。

用户安全实践建议

在强化系统安全的同时,OpenAI也敦促用户在使用AI代理时养成更安全的习惯:

- 限制访问权限:建议在不需要登录时使用"登出模式"。"我们继续建议用户利用登出模式...当手头任务不需要访问已登录网站时"。

- 验证而非盲目信任:当Agent尝试执行高风险操作(如发送电子邮件或进行购买)时,会请求用户许可。用户必须仔细审查这些请求。"当Agent要求确认操作时,请花时间验证操作是否正确"。

- 指令要具体明确:模糊指令会留下解释和操纵空间。"避免使用过于宽泛的提示,如'查看我的邮件并采取任何必要行动'。过大的自由度会使隐藏或恶意内容更容易影响Agent"。

参考来源:

ChatGPT Atlas Under Guard: OpenAI Fortifies Browser Agent Against “Prompt Injection” Attacks

本文为 独立观点,未经授权禁止转载。

如需授权、对文章有疑问或需删除稿件,请联系 FreeBuf

客服小蜜蜂(微信:freebee1024)