研究人员发现一种复杂的旁路攻击技术,即使流量受到端到端加密保护,攻击者仍能窃取用户与AI聊天机器人的对话主题。这项名为"Whisper Leak"的漏洞可使国家行为体、互联网服务提供商或Wi-Fi窃听者通过分析网络数据包大小和时间特征,推断出敏感提示内容。随着AI工具在医疗咨询、法律建议等日常场景的深度应用,该发现凸显了日益增长的隐私风险。

微软研究人员在最新博客中详细阐述了这种攻击方式,强调其对用户AI系统信任度的影响。攻击者通过分析大型语言模型(LLMs)的流式响应,无需解密数据即可对特定主题的提示进行分类。在专制政权地区,这种技术尤其危险——关于抗议活动、选举或被禁内容的讨论可能导致用户遭受迫害。

Whisper Leak工具包工作原理

OpenAI或微软等公司的AI聊天机器人采用逐令牌(token)生成回复的流式输出机制。这种自回归过程配合HTTPS等TLS加密协议通常能保护内容安全。但Whisper Leak瞄准的是元数据:数据包大小(与令牌长度相关)和到达时间间隔的差异会暴露话题特征。

研究方法包括对加密流量训练分类器。在PoC验证中,研究人员以"洗钱合法性"为主题生成100个提示变体,并与11,716个无关的Quora问题进行对比。通过tcpdump等工具捕获数据后,他们测试了LightGBM、Bi-LSTM和基于BERT的分类器。结果显示:在精确率-召回率曲线下面积(AUPRC)指标上,多个模型达到98%以上的准确率,能有效区分目标话题与噪声。

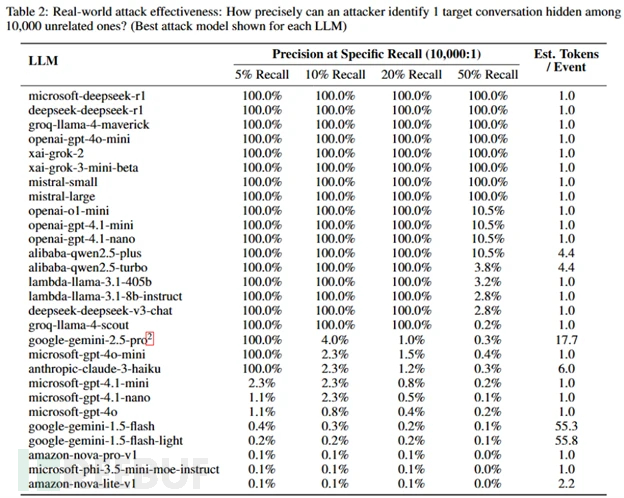

在模拟真实场景中,监控1万次对话的攻击者能以100%精确度和5-50%召回率标记敏感对话,这意味着误报率极低且能可靠捕获违规查询。该技术建立在Weiss等人的令牌长度推断和Carlini与Nasr的时序攻击研究基础上,但拓展至主题分类领域。

缓解措施

微软已联合OpenAI、Mistral、xAI及自家Azure平台部署修复方案。OpenAI新增"混淆"字段插入随机文本来掩盖令牌长度,大幅降低攻击可行性;Mistral引入"p"参数实现类似随机化,Azure也同步了这些变更。测试表明,更新后将风险降至可忽略水平。

专家建议用户:避免在公共网络讨论敏感话题、使用VPN、选择非流式模式、优先选用已修复的服务商。GitHub上开源的Whisper Leak代码库包含用于安全研究的示例代码。该事件凸显AI普及背景下强化隐私保护的紧迫性——虽然当前修复方案能应对直接威胁,但持续演变的攻击手段需要行业保持长期警惕。

参考来源:

New Whisper Leak Toolkit Exposes User Prompts to Popular AI Agents within Encrypted Traffic

本文为 独立观点,未经授权禁止转载。

如需授权、对文章有疑问或需删除稿件,请联系 FreeBuf

客服小蜜蜂(微信:freebee1024)