漏洞概述

一种名为"模型命名空间复用(Model Namespace Reuse)"的新型安全漏洞被发现,攻击者可利用该漏洞劫持谷歌Vertex AI和微软Azure AI Foundry等主流平台上的AI模型。Palo Alto Networks旗下Unit 42团队的研究显示,该漏洞源于AI模型采用的简易命名机制。

当前AI模型普遍采用"作者/模型名"的命名规则,这种命名空间(namespace)机制类似于网站域名,开发者通过名称引用模型。研究发现,当开发者在Hugging Face等平台删除账户或转移模型所有权后,原模型名称将重新开放注册。

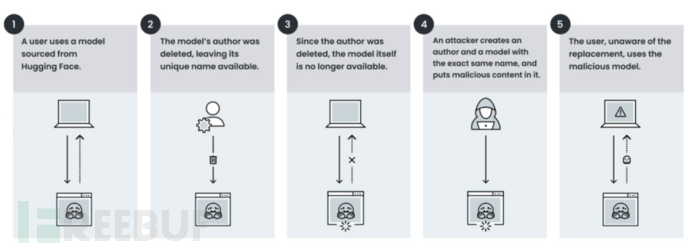

攻击原理

攻击者会注册已被释放的模型名称,并上传恶意版本模型。例如原"DentalAI/toothfAIry"模型删除后,攻击者可重新注册该名称并植入恶意模型。

攻击向量流程图(来源:Palo Alto Networks)

攻击向量流程图(来源:Palo Alto Networks)

由于多数开发者程序仅通过名称自动拉取模型,系统会在不知情的情况下下载恶意版本而非原始可信模型,从而为攻击者提供系统后门。Unit 42团队通过接管Hugging Face上仍被谷歌Vertex AI和微软Azure AI Foundry使用的模型名称,成功获得平台远程访问权限。该团队已向两家公司负贵披露漏洞,相关修复措施正在实施。

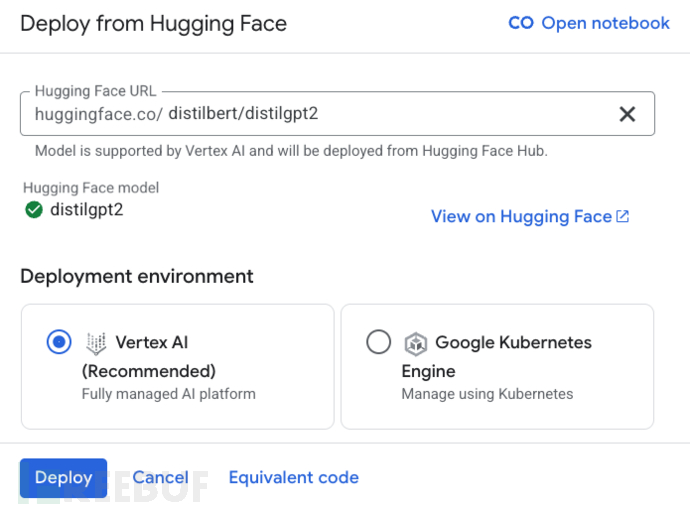

从Hugging Face部署模型至Vertex AI(来源:Palo Alto Networks)

从Hugging Face部署模型至Vertex AI(来源:Palo Alto Networks)

防护建议

研究表明,仅凭模型名称无法确保安全性,该漏洞不仅影响大型平台,还波及数千个采用相同命名机制的开源项目。安全专家建议开发者采取以下措施:

- 将模型"固定(pin)"到特定已验证版本,防止代码自动拉取新更新

- 模型经彻底检查后,下载存储至可信内部环境,消除上游变更风险

- 平台供应商与开发者需共同加强模型验证机制

专家观点

Sonatype首席安全研究员Garrett Calpouzos指出:"模型命名空间复用并非全新风险,本质上是仓库劫持(repo-jacking)的变体。"他强调模型名称不能证明其来源安全性,建议企业"固定到不可变版本",通过验证唯一标识符在构建时"直接阻断攻击或立即检测异常"。

参考来源:

Model Namespace Reuse Flaw Hijacks AI Models on Google and Microsoft Platforms

本文为 独立观点,未经授权禁止转载。

如需授权、对文章有疑问或需删除稿件,请联系 FreeBuf

客服小蜜蜂(微信:freebee1024)