随着数据泄露事件频发和消费者对隐私保护需求增加,企业面临合规和声誉风险,隐私专业人员的重要性凸显。ISACA报告指出,尽管部分组织增加了AI应用以缓解人员短缺,但技能缺口仍存,团队资源不足及工作压力大仍是主要挑战,未来需加强培训和预算投入以应对快速变化的技术与法规环境。 2025-8-18 07:1:9 Author: www.cybersecurity360.it(查看原文) 阅读量:14 收藏

Lo scenario attuale è sempre più caratterizzato dal crescente numero di violazioni dei dati personali. Mentre consumatori e cittadini richiedono maggiore tutela della privacy, le organizzazioni affrontano le gravi conseguenze dei data breach: sanzioni significative, danni reputazionali e perdita di fiducia da parte degli interessati.

In questo contesto, il ruolo dei professionisti della privacy diventa quanto mai essenziale. È infatti dimostrato che le organizzazioni che considerano la privacy una priorità, e dotano di risorse adeguate le funzioni aziendali preposte a gestirla, permettono ai team dedicati di raggiungere efficacemente gli obiettivi di protezione dei dati.

Il rapporto “

Il rapporto di ISACA (Information System Audit and Control Association) presenta i risultati di un sondaggio globale condotto alla fine del terzo trimestre del 2024.

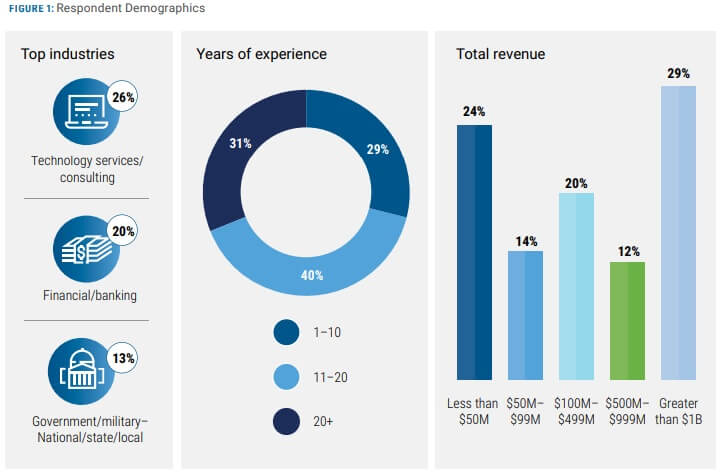

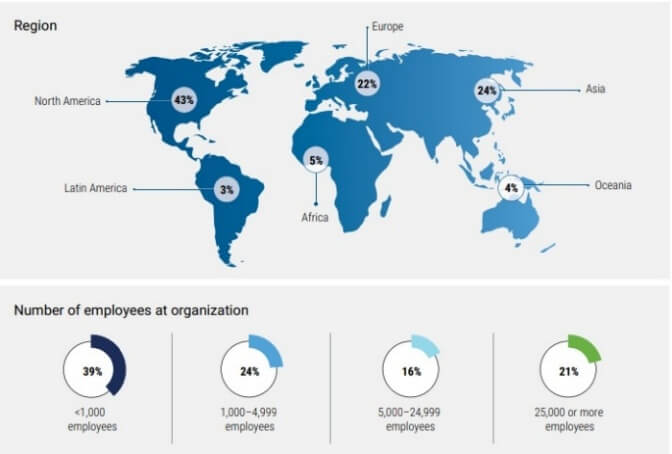

All’indagine hanno partecipato 1.600 professionisti provenienti dai settori tecnologico, finanziario e istituzionale/governativo/statale. I partecipanti rappresentano diversi livelli gerarchici e, precisamente: il 38% appartiene al top management, il 29% ricopre ruoli di senior leadership, il 20% è composto da collaboratori e il 12% da direttori esecutivi.

Il report offre una panoramica completa sullo stato della privacy, esaminando diversi aspetti: l’attenzione del CdA verso questa tematica, la conformità normativa, l’implementazione dell’intelligenza artificiale (AI) nel settore, i programmi formativi per aumentare la consapevolezza, le violazioni subite e l’importanza della privacy by design.

Di seguito sono riportate la distribuzione settoriale e geografica dei partecipanti all’indagine, nonché le dimensioni delle organizzazioni coinvolte.

Funzione legale/privacy vs. funzione IT

Il report evidenzia che team per la privacy integrano professionisti con competenze complementari e, precisamente: esperti tecnici che implementano controlli pratici e specialisti legali/di conformità che interpretano le normative. La collaborazione tra questi due gruppi è essenziale per garantire il rispetto degli obblighi normativi.

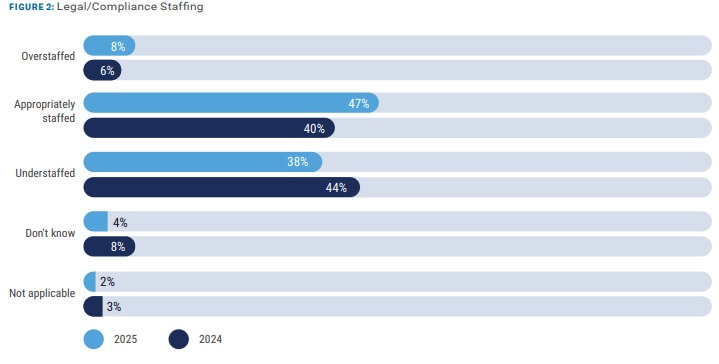

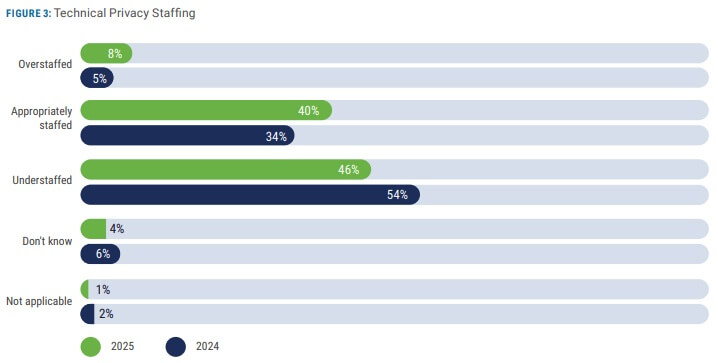

Il rapporto rivela un fenomeno interessante: nonostante una leggera riduzione del personale medio dedicato alla privacy (da nove a otto unità rispetto al 2023), la percezione di carenza di organico è diminuita.

Tuttavia, il 38% degli intervistati considera ancora sottodimensionato il proprio team legale/di conformità, mentre il 46% ritiene insufficiente il personale tecnico.

Tale apparente paradosso potrebbe essere attribuito all’incremento dell’utilizzo dell’Intelligenza Artificiale (IA) per supportare le attività di protezione dei dati: la quota di organizzazioni che adottano soluzioni di IA è infatti aumentata dal 18% al 24% nell’arco di un anno.

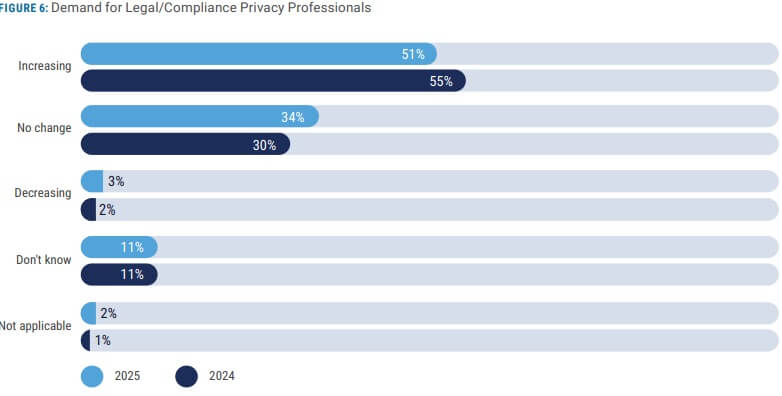

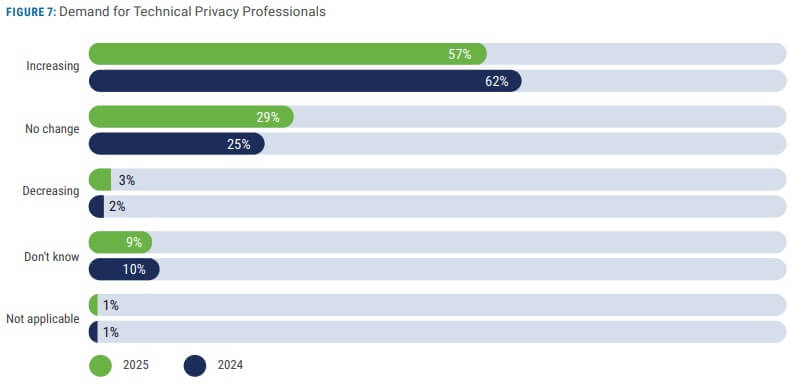

È interessante notare che, sebbene la richiesta di esperti in privacy rimanga consistente, risulti comunque inferiore rispetto all’anno precedente. Per quanto riguarda le prospettive future, il 51% dei partecipanti prevede una crescita della domanda per ruoli legali/di conformità, mentre il 57% anticipa un aumento nella ricerca di professionisti tecnici della privacy, superando così la richiesta di figure con competenze principalmente giuridiche.

Il reclutamento di figure dedicate alla privacy

Il 22% degli intervistati ha indicato che la propria organizzazione aveva ruoli aperti di praticante legale/di conformità e il 29% ha indicato che c’erano posizioni tecniche aperte per la privacy.

Si tratta di una diminuzione rispetto allo scorso anno, quando un quarto degli intervistati ha indicato ruoli legali/di conformità aperti e il 31% ha indicato ruoli tecnici di privacy aperti.

Dato che un numero inferiore di intervistati di quest’anno ritiene che la propria organizzazione sia a corto di personale, è logico che ci sarebbero meno posizioni aperte per la privacy.

La diminuzione dei ruoli vacanti nel settore della privacy può essere attribuita al fenomeno del “Big Stay”, una tendenza recente in cui i dipendenti rimangono più a lungo nelle loro posizioni attuali.

Un altro fattore che spiega la riduzione della percezione di carenza di personale per la privacy è la diminuzione del tempo necessario per coprire le posizioni aperte.

Il miglioramento potrebbe essere dovuto alla maggiore qualificazione dei candidati: il 29% degli intervistati ha riportato che più della metà dei candidati per posizioni legali/di conformità erano ben qualificati, e il 28% ha affermato lo stesso per i ruoli tecnici. Tali dati rappresentano un significativo progresso rispetto al 2024, quando solo il 21% degli intervistati considerava ben qualificati più della metà dei candidati per entrambe le tipologie di ruoli.

L’indagine ha identificato diversi fattori chiave che determinano la qualifica di un candidato (in linea con il 2023) e, precisamente:

- Esperienza in ambito conformità/legale (96%)

- Precedente esperienza pratica in ruoli di privacy (94%)

- Competenze tecniche (93%)

- Credenziali professionali (93%)

- Formazione pratica in materia di privacy (84%)

- Titolo di studio (70%)

- Referenze da precedenti datori di lavoro (69%)

La difficoltà di trovare candidati che uniscano ampie competenze sia tecniche sia legali/di conformità evidenzia l’importanza della collaborazione tra specialisti di entrambi gli ambiti.

È doveroso evidenziare che il reclutamento rimane particolarmente complesso per i profili di alto livello: il 73% degli intervistati indica che i professionisti esperti sono i più difficili da assumere, seguiti dai professionisti di livello intermedio (47%) e dai professionisti junior/entry-level (15%).

Inoltre, si prevede che, a fronte dell’aumento delle violazioni della privacy di alto impatto e la crescente attenzione dei consumatori verso tale tema, la domanda di professionisti della privacy continuerà a crescere.

Skill Gap

Il report di ISACA rivela che la maggior parte dei professionisti della privacy presenta la carenza dei seguenti skill:

- Esperienza con diversi tipi di tecnologie e/o applicazioni (61%)

- Esperienza con framework e/o controlli (49%)

- Competenza tecnica (48%)

- Conoscenze e competenze in materia di operazioni IT (43%)

- comprendere le leggi e i regolamenti a cui l’organizzazione è soggetta (42%),

- Informazioni aziendali (35%),

- Conoscenze e competenze in materia di reti e/o altre infrastrutture (32%)

- Competenze trasversali (29%) e l’etica aziendale (18%).

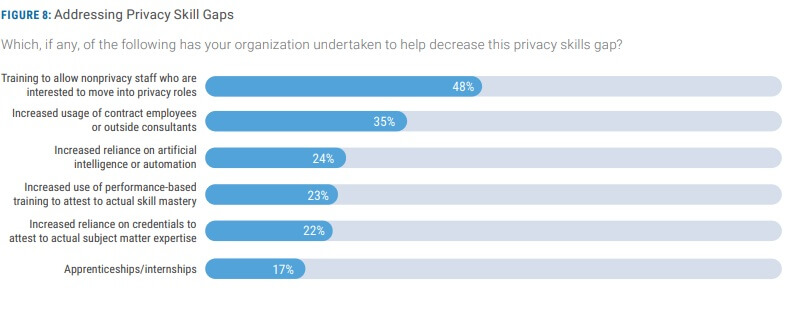

Le organizzazioni, come si può evincere dalla figura di seguito riportata, mettono in atto diverse strategie per ridurre tali skill gap.

Il 38% degli intervistati ha segnalato difficoltà, altresì, nel mantenere in azienda professionisti qualificati nel settore della privacy. Tale fenomeno è attribuibile principalmente all’incremento dello stress lavorativo. Infatti, ben il 63% degli esperti del settore considera il proprio ruolo più stressante rispetto a cinque anni fa, con il 34% che lo descrive come significativamente più logorante.

In particolare, gli intervistati hanno evidenziato tra principali fattori che rendono più stressanti i ruoli nel settore della privacy:

- La rapida evoluzione tecnologica (63%)

- Le sfide di conformità normativa (61%)

- La carenza di risorse (59%)

- La gestione di più priorità contemporaneamente (50%)

Le sfide che i team della privacy devono gestire

Il report di ISACA rivela che i team della privacy devono essere i grado di gestire diverse sfide e, precisamente:

- Complesso panorama giuridico e normativo internazionale (38%)

- Mancanza di risorse competenti (37%)

- Gestione del rischio associato alle nuove tecnologie (36%) • Mancanza di chiarezza su mandato, ruoli e responsabilità (35%).

- Mancanza di supporto da parte dei dirigenti o delle imprese (33%)

- Mancanza di visibilità e influenza all’interno dell’organizzazione (33%)

- Scarse pratiche di gestione dei dati (27%)

- Mancanza di una strategia sulla privacy e di una roadmap per l’implementazione (26%)

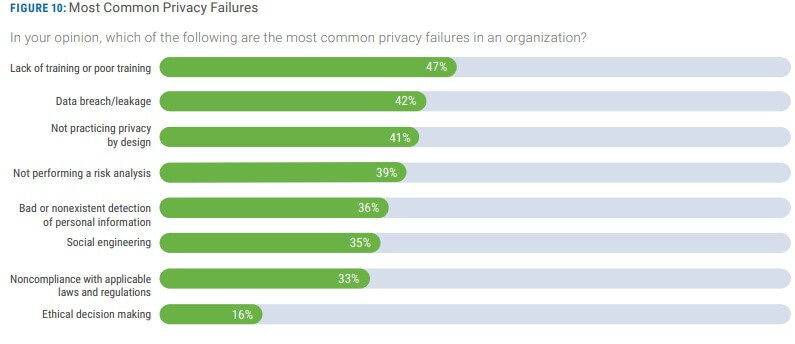

Di seguito le cause dei fallimenti più comuni in termini di privacy nelle organizzazioni rivelate dal report.

I risultati del sondaggio confermano, altresì, che i professionisti esperti della privacy, con precedenti competenze in ruoli di privacy o legali/normativi, sono fondamentali per l’efficace funzionamento di un programma di privacy.

Prioritizzazione della privacy

I Board che assegnano correttamente priorità alla privacy possono aiutare a garantire che i team per la privacy dispongano delle risorse e del supporto necessari per completare i loro obiettivi e garantire la conformità alla privacy.

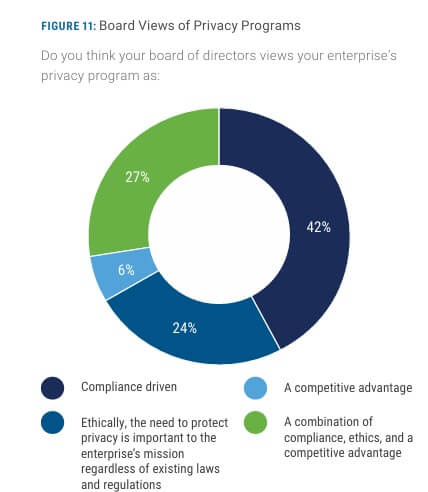

Poco più della metà degli intervistati (57%) ritiene che il proprio Board dia adeguata priorità alla privacy. Quasi tre quarti degli intervistati (74%) hanno affermato che la strategia sulla privacy della propria organizzazione è allineata con gli obiettivi organizzativi. La figura sottostante mostra il modo in cui i Board interpretano i programmi di privacy.

Interessante notare, altresì, come la responsabilità primaria della privacy all’interno delle organizzazioni è distribuita tra diverse figure dirigenziali, quali:

- Chief Privacy Officer (21%)

- Chief Information Officer (14%)

- Responsabile della sicurezza a livello dirigenziale (14%)

- Amministratore Delegato (11%)

- General Counsel/Chief Legal Officer (11%)

Inoltre, il rapporto mette in evidenza potenziali conflitti tra obiettivi di sicurezza e privacy: ad esempio, perseguire il “non ripudio” potrebbe compromettere la privacy. Inoltre, emergono anche possibili divergenze di priorità tra diverse figure, ovvero: mentre il General Counsel/Chief Legal Officer tende a concentrarsi sulla protezione dell’azienda, i professionisti della privacy generalmente danno priorità alla protezione degli interessati (i soggetti dei dati), creando una potenziale contraddizione tra i rispettivi obiettivi. Ne consegue che una corretta prioritizzazione della privacy da parte dei Board è fondamentale per garantire che i team dedicati ricevano risorse e supporto adeguati a raggiungere i loro obiettivi e ad assicurare la conformità normativa.

Budget per la privacy

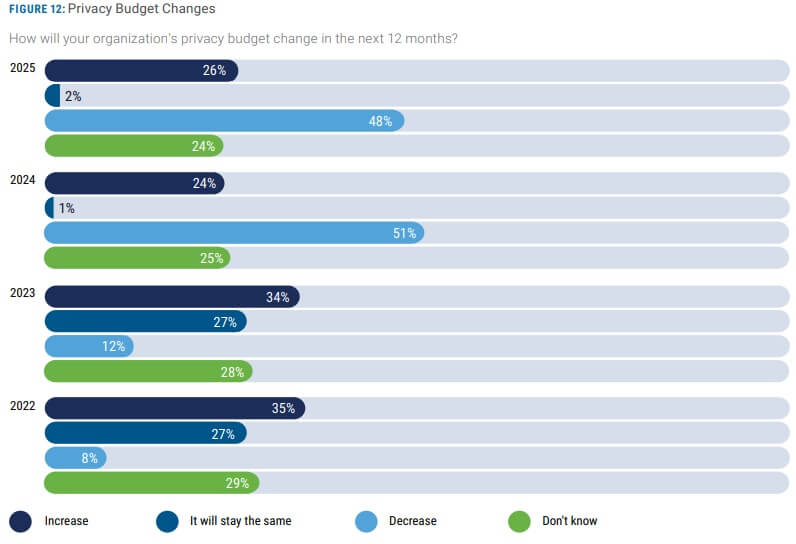

Il 43% degli intervistati considera il proprio budget non adeguato, mentre il 36% lo ritiene sufficiente. La figura che segue mostra come si prevede che i budget per la privacy diminuiranno nei prossimi 12 mesi e li confronta con i risultati dei sondaggi precedenti.

I risultati del sondaggio potrebbero essere preoccupanti per i professionisti della cyber security: con potenziali tagli ai budget per la privacy, gli esperti di cyber security potrebbero dover assumere anche alcune responsabilità legate alla privacy. Inoltre, alcuni team di leadership senior potrebbero faticare a comprendere la differenza tra sicurezza e privacy e perché entrambe siano fondamentali per guadagnare e mantenere la fiducia dei consumatori.

Conformità

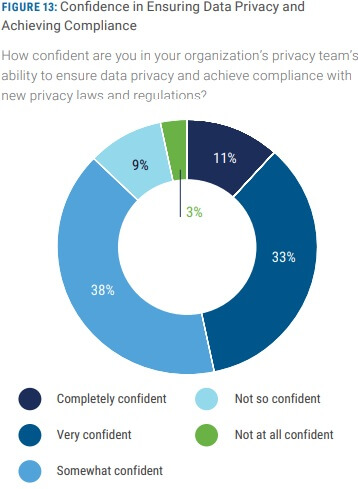

I requisiti normativi in materia di privacy hanno un impatto significativo sui programmi aziendali. L’82% delle organizzazioni utilizza un quadro di riferimento o una legge per gestire la privacy.

Occorre sottolineare che la complessità del quadro normativo rende indispensabile una stretta collaborazione con gli esperti legali. Solo un terzo delle organizzazioni intervistate dichiara di comprendere facilmente i propri obblighi in materia di privacy, a causa della molteplicità di leggi vigenti. Nonostante questa difficoltà, la maggior parte delle aziende esprime fiducia nella capacità del proprio team di assicurare il rispetto delle normative.

Il 68% delle organizzazioni intervistate considera essenziale affrontare la privacy con politiche, procedure e standard documentati e tale percentuale sale all’80% nelle organizzazioni in cui si dà priorità alla privacy.

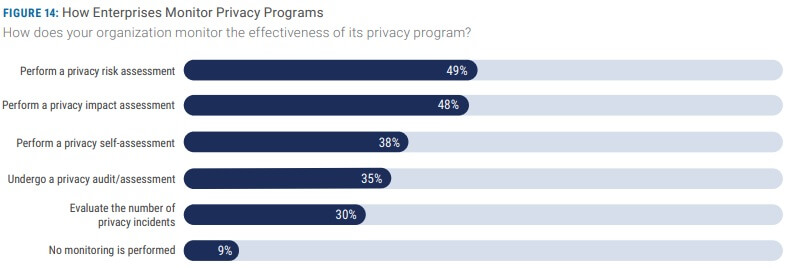

I metodi utilizzati per monitorare l’efficacia dei programmi di privacy sono diversi e, idealmente, le aziende dovrebbero combinarne diversi per ottenere una visione completa dell’efficacia del loro programma di privacy, come indicato nella figura seguente.

Utilizzo dell’AI a supporto della privacy

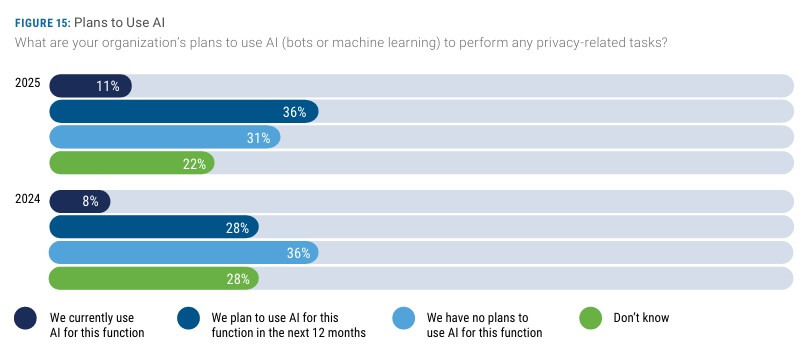

Il sondaggio di ISACA evidenzia come l’IA stia assumendo un ruolo sempre più importante per i professionisti della privacy.

Tuttavia, la tecnologia se da un lato offre potenziali vantaggi significativi, dall’altro lato introduce contemporaneamente nuove sfide che le organizzazioni devono affrontare nella gestione della protezione dei dati. Vediamo di che si tratta.

Potenziale dell’IA nella privacy

L’IA può supportare il lavoro dei professionisti della privacy, contribuendo a colmare le lacune di competenze e affrontare problemi di personale. L’IA aiuta anche a gestire meglio le enormi quantità di dati raccolti, facilitando la classificazione e l’identificazione delle informazioni personali.

È importante sottolineare che l’uso dell’IA comporta rischi, e le aziende devono valutare se impiegarla per attività legate alla privacy sia in linea con la loro propensione al rischio. La figura di seguito illustra come viene utilizzata l’IA nelle attività di privacy.

Il report di ISACA rivela che quest’anno più intervistati hanno utilizzato l’IA rispetto all’anno scorso. Inoltre, l’utilizzo dell’IA per compiti legati alla privacy è risultato più elevato nelle imprese che non si limitano a un approccio orientato alla mera conformità.

Solo il 9% degli intervistati, che operano in organizzazioni in cui Board considerano i programmi di privacy come semplice adempimento normativo, ha dichiarato di utilizzare attualmente l’IA, rispetto al 14% di coloro che operano in organizzazioni dove la privacy è vista come questione etica o vantaggio competitivo. Tale dato evidenzia che affidarsi esclusivamente alla conformità normativa per gestire la privacy penalizzerà le aziende.

Pertanto, sarà necessario sviluppare standard propri e linee guida etiche per l’uso delle tecnologie emergenti. Inoltre, le organizzazioni, poiché leggi e regolamenti non riescono a tenere il passo con le tecnologie in rapida evoluzione, dovranno andare oltre la semplice conformità.

L’uso attuale dell’IA è risultato inoltre più diffuso tra le aziende che applicano regolarmente il principio della privacy by design. Tra gli intervistati che hanno dichiarato di adottare sempre questo approccio, il 18% utilizza attualmente l’IA per compiti legati alla privacy.

Si tratta di un dato incoraggiante e che suggerisce l’integrazione della privacy by design nelle applicazioni di IA, rendendo il loro utilizzo più sicuro, oltre ad indicare che le organizzazioni, che utilizzano soluzioni di IA, comprendono l’importanza della protezione dei dati e adottano misure per dare priorità alla privacy.

Formazione sulla privacy

La formazione in termini di consapevolezza della privacy è fondamentale per aiutare i professionisti a operare tenendo conto della privacy e ridurre gli incidenti correlati. Secondo il report di ISACA, l’87% delle organizzazioni fornisce formazione in termini di consapevolezza della privacy ai dipendenti. Tuttavia, le organizzazioni, per mantenere questa formazione rilevante, devono aggiornarla regolarmente. A tal proposito il report rivela che:

- il 59% delle organizzazioni la aggiorna annualmente

- il 24% quando entrano in vigore nuove leggi o regolamenti,

- il 9% ogni due o cinque anni

- il 3% non la aggiorna mai

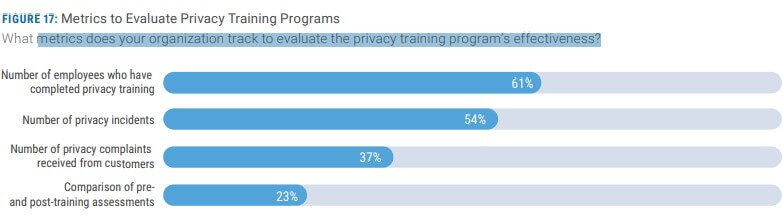

Inoltre, è importante misurare l’efficacia della formazione con metriche adeguate, poiché basarsi solo sul numero di incidenti di privacy può essere fuorviante. Di fatto, se da un lato un aumento degli incidenti segnalati dal personale può indicare una maggiore consapevolezza grazie alla formazione, dall’altro lato un aumento degli incidenti segnalati dai clienti può indicare la necessità di miglioramenti.

Il 61% degli intervistati ha evidenziato, altresì, che la formazione sulla privacy è ben distinta da quella sulla sicurezza e, qualora fossero combinate, è cruciale includere contenuti sufficienti e specifici per la privacy per evitare lacune. Nonostante queste sfide, l’86% degli intervistati ritiene che i programmi di formazione e di sensibilizzazione abbiano migliorato la consapevolezza della privacy tra i dipendenti.

La figura che segue rivela le metriche che le organizzazioni monitorano per valutare l’efficacia del programma di formazione sulla privacy.

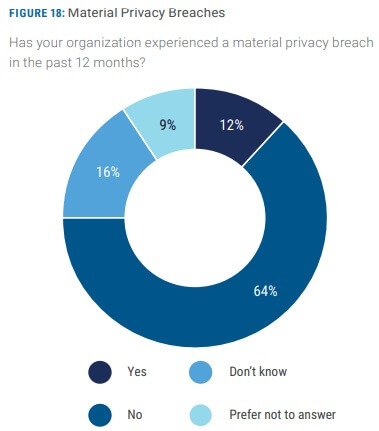

Violazioni della privacy

Le violazioni della privacy, come ben noto, possono causare gravi danni, tra cui: danni alla reputazione, perdita di fiducia dei consumatori e conseguenze normative.

Secondo quanto rivela il report di ISACA: l’11% delle organizzazioni intervistate ha subito una violazione sostanziale della privacy negli ultimi 12 mesi, il 63% non ha riportato violazioni, il 18% non ne è a conoscenza, mentre l’8% ha preferito non rispondere.

È importante sottolineare la significativa percentuale di intervistati che dichiara di non essere a conoscenza di violazioni, il che potrebbe indicare una carenza nella capacità delle organizzazioni di determinare se gli incidenti di sicurezza abbiano effettivamente compromesso dati personali.

Tale criticità potrebbe derivare da inadeguati sistemi di classificazione delle informazioni e da processi non ottimali nella gestione delle risposte agli incidenti. In effetti, una classificazione imprecisa dei dati non solo complica la risposta alle violazioni, ma ostacola anche il corretto adempimento degli obblighi normativi, come ad esempio le notifiche obbligatorie alle autorità di vigilanza.

Privacy by design

La privacy by design è un approccio che integra la privacy in ogni fase del processo di progettazione di prodotti e di servizi. Il 67% degli intervistati ha dichiarato che la propria organizzazione adotta questo approccio nella creazione di nuove applicazioni e di servizi. Tuttavia, solo il 27% degli intervistati pratica sempre la privacy by design, e tale percentuale aumenta tra quelli che lavorano con team specifici come approvvigionamento (52%) e sviluppo prodotto (49%).

Inoltre, la mancanza di collaborazione con team chiave può ostacolare l’implementazione efficace della privacy by design. Ancora, il 41% degli intervistati identifica la mancata pratica della privacy by design come un errore ricorrente.

Il report di ISACA rivela che le organizzazioni che praticano regolarmente la privacy by design tendono ad avere più supporto e risorse: il 50% di queste organizzazioni afferma che il budget per la privacy è adeguato, rispetto al 36% del totale degli intervistati. Inoltre, tali organizzazioni dispongono di un numero maggiore di addetti alla privacy e meno carenze di personale tecnico.

Inoltre, un Board non orientato esclusivamente alla conformità è meno comune tra le aziende che praticano la privacy by design, il che permette un approccio più proattivo e basato sul rischio. Inoltre, tali organizzazioni hanno strategie di privacy allineate con gli obiettivi organizzativi (91% rispetto al 74% totale) e sono più propense a documentare politiche e procedure di privacy (89% rispetto al 68% totale).

Il report di ISACA rivela un dato interessante, ovvero: nonostante i benefici, il 10% delle aziende che praticano sempre la privacy by design ha subito violazioni della privacy nell’ultimo anno, un dato comunque inferiore rispetto al 12% del totale degli intervistati. Ciò indica che, sebbene la privacy by design riduca i rischi, non elimina completamente la possibilità di violazioni.

Previsioni 2025 in materia di privacy globale

A fronte dello scenario descritto dall’ISACA report e considerando la vigente galassia normativa europea in termini di privacy e cyber resilience, le organizzazioni, nel 2025, dovranno essere in grado di affrontare numerose sfide. Vediamo quali.

Preponderanza dell’IA

L’IA sarà sempre più integrata nella vita quotidiana, sollevando questioni di autodeterminazione e controllo sulla privacy. Di fatto, a fronte del crescente utilizzo di “compagni di IA”, la protezione dei dati sensibili diventerà cruciale.

Evoluzione della legislazione sull’IA a livello globale

Nell’area Asia-Pacifico, le giurisdizioni mature come Giappone, Singapore, Cina e Australia adotteranno un approccio moderato, osservando prima gli sviluppi dell’AI Act in Europa e negli USA.

In EU l’implementazione dell’AI Act porterà alla creazione di codici di condotta e standard specifici, con un ruolo più attivo delle DPAs (Data Protection Authority) nell’applicazione del GDPR.

In America Latina assisteremo ad un’accelerazione legislativa, con il Brasile che si ritiene riuscirà a pubblicare una legge completa entro il 2025.

Trasferimenti internazionali di dati

I flussi di dati transfrontalieri diventeranno un tema centrale, con possibili frammentazioni. Gli USA limiteranno i trasferimenti verso alcuni paesi, mentre l’UE promuoverà flussi solo verso paesi con protezioni adeguate.

Privacy dei giovani e la sicurezza online

Si intensificherà il dialogo sulla sicurezza online dei minori, con un focus sull’integrazione dei “diritti dei minori fin dalla progettazione”.

Il regolamento CSAR (Child Sexual Abuse Regulation) continuerà a essere dibattuto, mentre le esperienze del Regno Unito forniranno indicazioni sul bilanciamento tra privacy e sicurezza dei giovani.

Conclusione

In questo scenario altamente digitalizzato e innovativo, la sfida fondamentale consiste nel trovare un equilibrio tra progresso tecnologico e tutela dei dati considerando la continua diffusione dell’IA.

Ciò richiede l’integrazione dei principi di “privacy by design” e “security by design” sin dalle fasi iniziali di sviluppo dei sistemi, seguendo criteri di gestione del rischio, continuità operativa e cybersecurity.

È doveroso ricordare che un ecosistema digitale sicuro e sostenibile potrà emergere solo se si riuscirà a garantire: quadri normativi ben definiti, cooperazione internazionale rafforzata, adozione di pratiche etiche e trasparenti da parte delle aziende e degli operatori del settore, nonché programmi educativi che promuovano un utilizzo consapevole delle tecnologie da parte degli utenti.

Pertanto, la strada verso il futuro – in cui sicurezza, privacy e avanzamento tecnologico coesistano armoniosamente – passa necessariamente attraverso la collaborazione tra stakeholder, l’investimento in ricerca e lo sviluppo di soluzioni innovative.

Solo così si potranno creare le condizioni per un ecosistema digitale caratterizzato da fiducia, resilienza e sostenibilità, nel rispetto dei diritti fondamentali della nostra società.

如有侵权请联系:admin#unsafe.sh