[上图是由Stable Diffusion自动生成,再也不用操心文章配图问题]

我对大模型的理解

大约在五年前,我就有一种体会,世界或者说是宇宙,本质是由一个个参数构成的,小到原子的结构,分子的构成,大到人体的构造、工具的组成,都离不开亿万级的参数。我们是否可以通过亿万级参数的拟合,来发现世界的规律,预测事物的走向,从而看到命运的终局。

一个月前,在团队内部进行了一次技术分享《我对ChatGPT是有点失望的》,当时深入研究ChatGPT后,发现实际情况远赶不上自媒体标题吹嘘的那样,也达不到我的一个预期,距离发现世界的底层规律还很远。但是类GPT-4的系列大模型让我看到了一些在这方面的更深入的实践。以前AI还是弱智能,现在的大模型相较于以前,无疑是变强了很多。

强AI有机会发展成为神,但目前还远远不够。目前大模型的构成动辄千亿、万亿的参数量,其训练数据是海量的人类知识,但其训练数据还只是人类文明的很小一部分,如果再快速扩张,理论上可以用全人类文明训练出来一个超大型模型,模型理论上限可以被认为是代表了人类每个个体智能的最大公约数。

未来,大模型普及后,我们每个个体渺小而又平等。一方面,我们每个个体在大模型面前,都将非常渺小,因为大模型代表着整个人类文明。另一方面,我们每个个体又是平等的,因为大模型会给每个人开挂,弥补所谓先天智力、后天几十年学院和职业教育养成的知识差距。届时,带来的影响可能是资本主义的消失和社会现有分工体系的瓦解。资本主义的核心做法是专业的人做专业的事,每个人因为生产力和生产关系而相互协作,从而效率最大化,而强AI无疑打破了这一规律,因为所有人都不再重要,只有造AI和维护AI的人最关键,剩下的生产工作全部交给机器人执行。

GPT-4

GPT-4是一款大型多模态语言模型,能够处理图像和文本输入并生成文本输出。

GPT-4能力

自然语言理解能力

各类评测任务中很能打:学术专业考试、NLP评测任务

构建可预测扩展的深度学习堆栈,预测模型表现,增强训练信心。解决的问题是大模型调优很困难。解决方法是开发深度学习基础设施和优化方法,使其能够在广泛的规模范围内可预测地运行。达到的效果是可以以类似方式训练的小规模运行来预测GPT-4的预期性能。

耗时6月的安全性控制,油门有多大,刹车就要有多强

多模态能力

看图理解:很搞笑,用着看上去是VGA的插口给手机充电,GPT-4竟然回答对了。

图表理解

做物理题:妈妈再也不用担心我的学习

读论文:直接就喂饭

GPT-4和GPT3.5区别

技术层面区别

多模态:图片和文本

模型参数量只会更大

后训练策略:增加了RLHF(安全性)、RBRMS(安全规则反馈模型)

CloseAI并未公布具体细节,根据现有表现整理如下:

GPT4 | ChatGPT | GPT3 | GPT2 | GPT | |

模型结构 | Transformer-Style | Decoder | Decoder | Decoder | Decoder |

模型参数量 | ?(更大) | ? | 175B | 1.5B | 117M |

训练数据量 | ? | ? | 600GB | 40G | 4G |

后训练策略 | RLHF+RLHF(安全性)+RBRMS | RLHF | - | - | - |

效果层面差别

和GPT-3.5的差别:

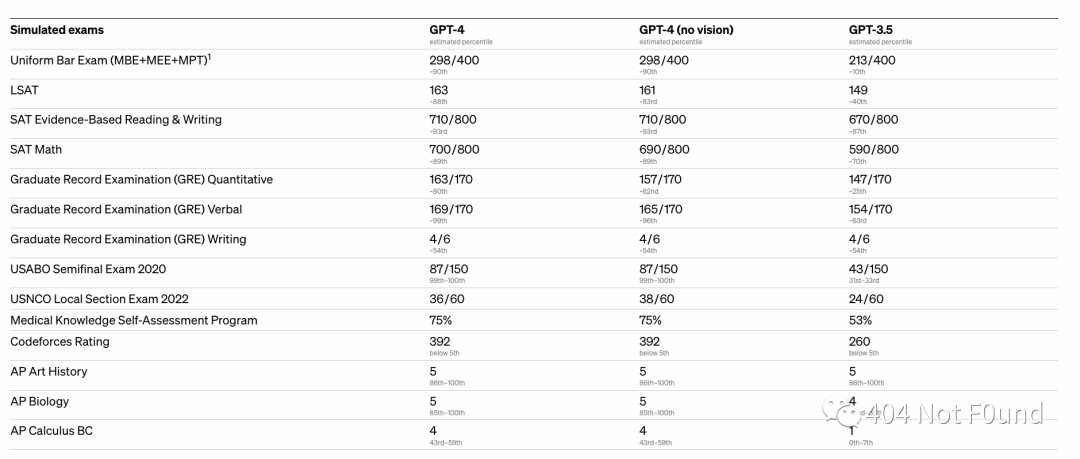

GPT-4去考试排名top10%,而GPT-3.5排名bottom 10%

GPT-3.5是在部分任务上可以媲美SOTA

GPT-4是在绝大多数任务上超越SOTA,超越GPT-3.5

微软的做法

微软用GPT-4赋能网络安全业务

战略:数据【威胁情报】、算法【AI】、算力【云】

AI核心能力:加速整个pipline处理流程各个环节,提升生产力和效率

产品:Microsoft Security Copilot

定位:安全始终以人为本,并非取代安全人员的工作,而是辅助/赋能安全分析师更高效输出价值。

技术:延续了ChatGPT的问答模式,核心技术是GPT-4和安全专用模型

产品构成:OpenAI 的最先进技术和模型+微软安全+AI 基础架构+安全专家训练的模型+大规模的威胁情报数据+e2e 的安全工具

能力:以机器速度去防御

化繁为简,提高效率

未知风险发现

解决人才缺失问题

产品发布会视频分析:

演示1:

解释下log4j漏洞

把响应钉住到右侧,方便联合分析

windows设备受影响吗

windows 9是什么鬼

解释了AI会犯错,比较真实

可以上报问题

演示2:

在域账号和设备失陷事件中

逆向恶意代码

输出可视化的攻击路径,下载、利用、移动

具体案例:域账号和设备失陷场景事件处置。

事件响应

从Microsoft Sentinel【SIEM】拉取事件信息并分析

选项“恶意软件分析” or “通用事件分析”,比较像推荐 或是 剧本

完整视频,建议逐帧看完

威胁狩猎

从Microsoft Defender【XDR】拉取攻击信息,推荐选项,邮件分析

Promptbook,类似SOAR的剧本,还原攻击路径。在这起事件中谁发送了、谁收到了含有恶意链接的邮件,在这起事件前10多天用户有哪些异常登录行为

完整视频,建议逐帧看完

3. 生成安全报告

微软同时也声明:your data is your data,用户可以安心使用。

微软用GPT-4赋能自营业务

微软主营业务:以云为核心,包括云硬件服务、云软件服务

套路:AI挨个赋能自营业务

bing搜索引擎【AI赋能】

office全家桶【AI赋能】

安全业务【AI赋能】

我们要做的

在应用领域,GPT-4是一个速度倍增器,可以用来强化/增强/辅助/加速现有技术、效率和生产力。

大模型方面

使用OpenAI API

使用开源工具/产品替代,并本地化

和公司内相关大模型团队合作,使用其服务和资源

安全方面

寻找可以产生实际价值的安全场景,并落地。

寻找的方法可以是:类似“问答”的交互式场景。例如:

增强攻击欺骗技术

做法:预设不同的角色给到GPT模型,例如终端角色,如果攻击者输入cat /etc/passwd,GPT就会返回相应信息,以假乱真,生成符合预期的与攻击者交互的“攻击和响应”对话内容,但也要注意拦截偏离预期的回答

创新点:既可以模拟高交互性,又可以保证自身安全性,又是攻击视角数据,不涉及数据安全问题

增强可信纵深检测和防御体系

目标:高效训练可信策略/模型

做法:预设场景提问,给出预期内行为的定义,让GPT直接去预测。或是给出正常行为数据,让GPT自己总结出预期内行为的特征和规律,辅助/加速做可信策略

安全大模型

通用大模型直接应用于安全领域,不失为一种快速的应用方法,当然效果也许会打一些折扣,提升点是在通用大模型的基础上,在训练阶段增加安全领域知识,训练一个既通用又专业的安全大模型,避免犯windows9的类似错误。

《大模型不扩散条约》

虽然现阶段,国内外都会遇到一些问题,例如橘生淮南则为橘,橘生淮北则为枳、汉语博大精深。

Stable Diffusion。是一个深度学习,文本到图像模型,发布于2022年。它主要用于生成以文本描述为条件的详细图像,它也可以应用于其他任务,例如在文本提示符的引导下进行补绘、补绘和生成图像到图像的翻译。它是由初创公司Stability AI与一些学术研究人员和非营利组织合作开发的。

提示词:英文,a dog,输出符合预期

提示词:中文,一只狗,输出一个瓷娃娃,不符合预期

百度的文心一言。

提示词:中文,一只狗,输出符合预期

提示词:网友测过,中文,鱼香肉丝、红烧狮子头,输出不符合预期,没有真正理解中文语意

但大模型关键技术未来可能是数字化时代的核武器,抢先自主和可控很重要。自主是因为国外的GPT不一定适应国内的环境,GPT系列毫无疑问在英文场景效果会好于中文效果,因为其是土生土长在国外,训练数据也是英文远大于中文,不一定能很好的解决我们的问题。可控是因为GPT系列技术属于核心科技,OpenAI也会变成CloseAI。抢先是因为各个厂商已经开启军备竞赛,可能就像搞核武器一样,等巨头们占领科技制高点后,就签署《不扩散核武器条约》。

如有侵权请联系:admin#unsafe.sh